ChatGPT

| ChatGPT | |

|---|---|

| |

| |

| Тип | языковая модель, виртуальный собеседник, прототип, ИИ и проприетарное программное обеспечение |

| Автор | OpenAI |

| Разработчик | OpenAI |

| Языки интерфейса | многоязычный, в том числе русский |

| Первый выпуск | 30 ноября 2022 года |

| Аппаратная платформа | браузер |

| Последняя версия | (14 марта 2023) |

| Состояние | функционирует |

| Лицензия | Проприетарная |

| Сайт | chat.openai.com/chat |

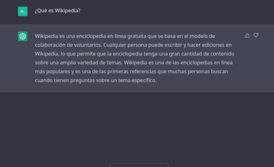

ChatGPT (англ. Generative Pre-trained Transformer или рус. генеративный предварительно обученный трансформер) — чат-бот с искусственным интеллектом, разработанный компанией OpenAI и способный работать в диалоговом режиме, поддерживающий запросы на естественных языках. ChatGPT — большая языковая модель, для тренировки которой использовались методы обучения с учителем и обучения с подкреплением. Данный чат-бот основывается на другой языковой модели от OpenAI — GPT-3.5 — улучшенной версии модели GPT-3. 14 марта 2023 года была выпущена языковая модель GPT-4, доступная тестировщикам и платным подписчикам ChatGPT Plus[1][2]. В новой версии у ИИ появилась возможность обработки не только текста, но и картинок[1].

ChatGPT был запущен 30 ноября 2022 года и привлёк внимание своими широкими возможностями: написание кода, создание текстов, возможности перевода, получения точных ответов и использование контекста диалога для ответов, хотя его фактическая точность и подверглась критике.

В начале февраля 2023 года Reuters со ссылкой на швейцарский холдинг UBS сообщило, что за 2 месяца аудитория активных пользователей ChatGPT достигла 100 млн человек. Этим самым приложение установило исторический рекорд по росту посетителей[3].

Доступ к сервису ограничен в таких странах как Китай, Россия, Белоруссия, Афганистан, Венесуэла, Иран[4]. Также ранее сервис не был доступен для жителей Украины[5].

Особенности

ChatGPT был доработан поверх GPT-3.5 с использованием методов обучения как с учителем, так и с подкреплением[6]. В обоих подходах использовались люди-тренеры для улучшения производительности модели. В случае обучения с учителем модель была снабжена беседами, в которых тренеры играли обе стороны: пользователя и помощника по искусственному интеллекту. На этапе подкрепления инструкторы-люди сначала оценивали ответы, которые модель создала в предыдущем разговоре. Эти оценки были использованы для создания моделей вознаграждения, на которых модель была дополнительно доработана с использованием нескольких итераций Proximal Policy Optimization[7][8]. Алгоритмы Proximal Policy Optimization имеют преимущество по затратам по сравнению с алгоритмами Region Policy Optimization; они сводят на нет многие дорогостоящие в вычислительном отношении операции с более высокой производительностью[9][10]. Модели были обучены в сотрудничестве с Microsoft на их суперкомпьютерной инфраструктуре Azure.

По сравнению со своим предшественником, InstructGPT, ChatGPT пытается уменьшить количество вредных и вводящих в заблуждение ответов. Например, в то время как InstructGPT воспринимает сообщение о том, что Христофор Колумб прибыл в США в 2015 году как правдивое, ChatGPT использует информацию о путешествиях Колумба и информацию о современном мире, включая восприятие личности Колумба, чтобы построить ответ, предполагающий, что произошло бы, если бы Колумб приплыл в США в 2015 году[7]. Данные в распоряжении у ChatGPT включают в себя справочные страницы, информацию об интернет-феноменах и информацию о языках программирования[11].

В отличие от большинства чат-ботов, ChatGPT отслеживает состояние пользователя, запоминая предыдущие вопросы и ответы, данные ему в том же разговоре, что, по мнению некоторых журналистов, позволит использовать ChatGPT в качестве персонализированного терапевта[12]. В попытке предотвратить выдачу оскорбительных результатов от запросов пользователей и получение оскорбительных ответов, в ChatGPT запросы фильтруются через API модерации, а потенциально расистские или сексистские подсказки отклоняются[7][12].

ChatGPT имеет множество ограничений. Модель вознаграждения ChatGPT, разработанная с учётом человеческого надзора, может быть чрезмерно оптимизирована и, таким образом, снижать производительность, представляя собой закон Гудхарта[13]. При обучении рецензенты предпочитали более длинные ответы, независимо от фактического понимания или фактического содержания[7]. Данные у ChatGPT могут страдать от алгоритмической предвзятости; ответы, включающие расплывчатые описания людей, таких как генеральный директор, могут генерировать ответ, предполагающий, что такой человек, например, является белым мужчиной[14].

Реакция

Положительная

ChatGPT был встречен в целом положительными отзывами. Саманта Лок из The Guardian отметила, что он смог сгенерировать впечатляюще подробный и похожий на человеческий текст[15]. Технический писатель Дэн Гиллмор использовал ChatGPT в студенческом задании и обнаружил, что сгенерированный им текст соответствует тому, что мог бы предоставить хороший студент, и высказал мнение, что перед академическими кругами стоят некоторые очень серьёзные проблемы[16]. Алекс Кантровиц из Slate одобрил ответ ChatGPT на вопросы, связанные с нацистской Германией, включая утверждение о том, что Адольф Гитлер строил автомагистрали в Германии, которое было встречено информацией об использовании нацистской Германией принудительного труда[17]. В статье, посвящённой мнению, экономист Пол Кругман писал, что ChatGPT повлияет на спрос работников умственного труда[18]. Джеймс Винсент из The Verge расценил вирусный успех ChatGPT как свидетельство того, что искусственный интеллект стал мейнстримом[8]. В The Atlantic Стивен Марке отметил, что влияние на академические круги и особенно на прикладные эссе ещё предстоит понять[19]. Учитель средней школы Калифорнии и писатель Дэниел Герман написал, что ChatGPT ознаменует конец английского языка в средней школе[20].

Критика

Фактическая точность ChatGPT, помимо прочего, была поставлена под сомнение. Майк Перл из Mashable задал ChatGPT множество вопросов. В одном примере он попросил назвать самую большую после Мексики страну в Центральной Америке. ChatGPT ответил, что это Гватемала, хотя правильный ответ — Никарагуа[21]. В декабре 2022 года веб-сайт вопросов и ответов Stack Overflow запретил использование ChatGPT для генерации ответов на вопросы, сославшись на фактически неоднозначный характер ответов ChatGPT[22]. Экономист Тайлер Коуэн выразил обеспокоенность по поводу его влияния на демократию, сославшись на способность любого человека писать автоматические комментарии в попытке повлиять на процесс принятия новых нормативных актов[23]. Акс Шарма из Bleeping Computer отметил, что ChatGPT способен писать вредоносные программы и фишинговые электронные письма[24].

ChatGPT также ничего не знает о событиях, происходящих после 2021 года, потому что он не обучается на наборах данных, собранных после этой даты[25].

Из-за опасений по поводу негативного воздействия на обучение, а также опасений по поводу безопасности и точности генерируемого системой контента, доступ к ChatGPT ограничен в сетях и на устройствах государственных школ Нью-Йорка[26].

На популярность нейросети OpenAI отреагировали крупнейшие технологические корпорации: Google объявили о начале тестирования своего чат-бота Bard[27]; Microsoft встроила ChatGPT в строку поиска Bing[28].

Крупнейшим IT-компаниям Китая, несмотря на официальный запрет, было предписано не использовать ChatGPT в своих продуктах. Государственная China Daily сообщила, что чат-бот может способствовать распространению информации в геополитических интересах США[29].

В России

Сервисы OpenAI легально недоступны пользователям из России. Однако использование подходящих VPN и сервисов по аренде телефонных номеров, принадлежащих по телефонному коду другим странам, позволяет получить доступ к сервису[30].

Примечания

- ↑ 1 2 Создатели чат-бота ChatGPT представили новое поколение языковой модели. GPT-4 умеет обрабатывать не только текст, но и картинки. Meduza (14 марта 2023). Дата обращения: 15 марта 2023.

- ↑ GPT-4 (англ.). openai.com. Дата обращения: 15 марта 2023.

- ↑ ChatGPT Set Record for fastest growing user base — analyst note.

- ↑ Что такое ChatGPT и как им пользоваться в России и Беларуси (рус.). «Дзен». (21 января 2023). Дата обращения: 9 февраля 2023.

- ↑ Американский OpenAI объяснил, почему заблокировал сверхпопулярный ИИ-сервис ChatGPT для украинцев (рус.). «Forbes». (18 января 2023). Дата обращения: 10 февраля 2023.

- ↑ Knox, W. Bradley; Stone, Peter. Augmenting Reinforcement Learning with Human Feedback (PDF). University of Texas at Austin. Дата обращения 5 December 2022.

- ↑ 1 2 3 4 OpenAI. ChatGPT: Optimizing Language Models for Dialogue (30 ноября 2022). Дата обращения: 5 декабря 2022.

- ↑ 1 2 Vincent, James ChatGPT proves AI is finally mainstream — and things are only going to get weirder. The Verge (8 декабря 2022). Дата обращения: 8 декабря 2022.

- ↑ Schulman, John; Wolski, Filip; Dhariwal, Prafulla; Radford, Alec & Klimov, Oleg (2017), Proximal Policy Optimization Algorithms, arΧiv:1707.06347 [cs.LG].

- ↑ van Heeswijk, Wouter Proximal Policy Optimization (PPO) Explained. Towards Data Science (29 ноября 2022). Дата обращения: 5 декабря 2022.

- ↑ Edwards, Benj No Linux? No problem. Just get AI to hallucinate it for you. Ars Technica (5 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ 1 2 Roose, Kevin The Brilliance and Weirdness of ChatGPT. The New York Times (5 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ Gao, Leo; Schulman & Hilton, Jacob (2022), Scaling Laws for Reward Model Overoptimization, arΧiv:2210.10760 [cs.LG].

- ↑ Murphy Kelly, Samantha This AI chatbot is dominating social media with its frighteningly good essays. CNN (5 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ Lock, Samantha What is AI chatbot phenomenon ChatGPT and could it replace humans? The Guardian (5 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ Hern, Alex AI bot ChatGPT stuns academics with essay-writing skills and usability. The Guardian (4 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ Kantrowitz, Alex Finally, an A.I. Chatbot That Reliably Passes "the Nazi Test". Slate (2 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ Krugman, Paul Does ChatGPT Mean Robots Are Coming For the Skilled Jobs? The New York Times (6 декабря 2022). Дата обращения: 6 декабря 2022.

- ↑ Marche, Stephen The College Essay Is Dead. The Atlantic (6 декабря 2022). Дата обращения: 8 декабря 2022.

- ↑ The End of High-School English Daniel Herman, The Atlantic, DECEMBER 9, 2022

- ↑ Pearl, Mike The ChatGPT chatbot from OpenAI is amazing, creative, and totally wrong. Mashable (3 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ Vincent, James AI-generated answers temporarily banned on coding Q&A site Stack Overflow. The Verge (5 декабря 2022). Дата обращения: 5 декабря 2022.

- ↑ Cowen, Tyler ChatGPT Could Make Democracy Even More Messy. Bloomberg News (6 декабря 2022). Дата обращения: 6 декабря 2022.

- ↑ Sharma, Ax OpenAI's new ChatGPT bot: 10 dangerous things it's capable of. Bleeping Computer (6 декабря 2022). Дата обращения: 6 декабря 2022.

- ↑ scienceblog. Ядерный синтез в изложении искусственного интеллекта. (рус.). scienceblog (24 декабря 2022). Дата обращения: 22 января 2023.

- ↑ Образовательные учреждения блокируют доступ к нейросети ChatGPT. Что дальше? // РГ, 7.01.2023

- ↑ Google представила собственное решение для «нейросетевой» конкуренции с Microsoft // Газета.ru, 7 февраля 2023

- ↑ Microsoft встроила ИИ-чат-бот ChatGPT в поисковик Bing и браузер Edge // 3DNews Daily Digital Digest

- ↑ Китайским IT-гигантам запретили использовать ChatGPT — бота обвинили в дезинформации и манипуляциях в интересах США

- ↑ Мария Решетникова. Что такое ChatGPT и на что он способен (2 февраля 2023). Дата обращения: 9 февраля 2023.

Ссылки

- Официальный сайт (англ.). Дата обращения: 18 февраля 2023.

- Валерий Романов. Билл Гейтс сравнил ChatGPT с изобретением интернета (10 февраля 2023). Дата обращения: 18 февраля 2023.

- Dario Spilimbergo Interview mit dem Chatbot GPT (англ.) (Audiostream). sirup.fm - Studierendenradiosendung von der Universität Zürich und der ETH Zürich (23 декабря 2022). Дата обращения: 23 декабря 2022.

Информация

Статья ChatGPT в русской Википедии заняла в местном рейтинге популярности следующие места:

- 28-е место 2023-03-10

- 35-е место 2023-03-11

- 31-е место 2023-03-12

- 29-е место 2023-03-13

- 17-е место 2023-03-14

- 10-е место 2023-03-15

- 9-е место 2023-03-16

- 20-е место 2023-03-17

- 33-е место 2023-03-18

- 24-е место 2023-03-19

- 13-е место 2023-03-20

- 14-е место 2023-03-21

- 23-е место 2023-03-22

- 24-е место 2023-03-23

О странице

Представленный контент статьи из Википедии был извлечен 2023-03-24 на основе https://ru.wikipedia.org/?curid=9999814